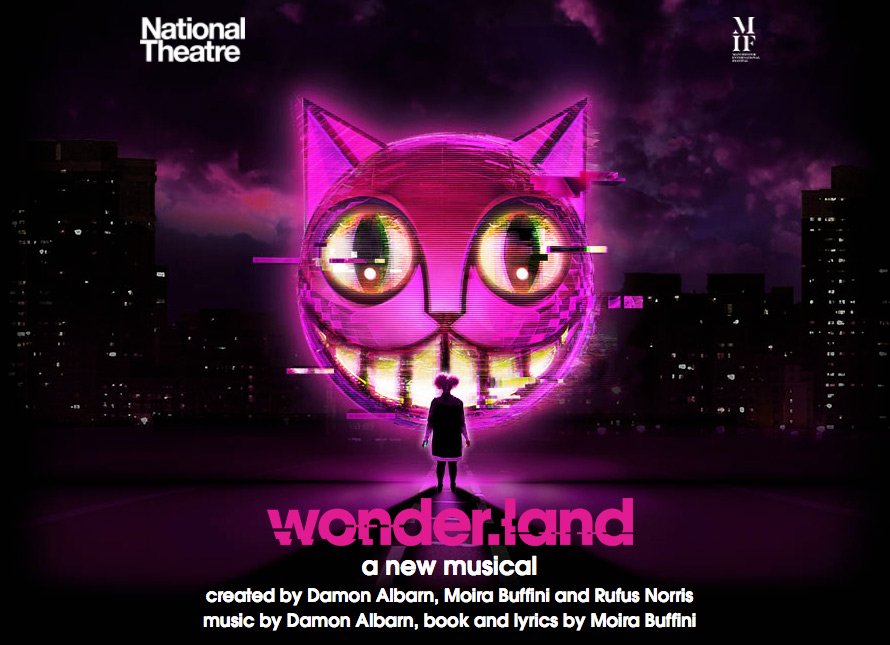

wonder.land est une comédie musicale inspirée du célèbre ouvrage de l’écrivain Lewis Caroll : « Alice au pays des merveilles ». Les dialogues et paroles de ce spectacle ont été écrits par Moira Buffini et la musique par Damon Albarn (Blur/Gorillaz).

Le directeur musical de wonder.land, David Shrubole, m’a appelé pour travailler sur cette comédie musicale ambitieuse. Le lancement de ce show eut lieu au Palace Theatre à Manchester en Juillet 2015 pour dix représentations à l’occasion du Manchester International Festival. Il fut ensuite programmé pour trois mois au Royal Festival Hall à Londres et pour dix représentations au Théâtre du Châtelet à Paris.

J’avais déjà travaillé avec David en tant que programmeur Ableton sur la comédie musicale “American Psycho”. Les comédies musicales sont toujours un challenge à configurer dû à la flexibilité de la ligne de temps. En effet, la vitesse de jeu des acteurs varie d’une représentation à l’autre et donc, la musique, la vidéo, et les lumières doivent être contrôlables en temps réel par le chef d’orchestre.

Pré-production

Le travail pour wonder.land a commencé en Mai 2015 avec les premières répétitions à Londres, où nous avons inspecté tous les aspects techniques du spectacle. Voici 2 petites vidéos qui vous donneront une idée de ce qu’étaient ces répétitions.

Voici les contraintes techniques auxquelles nous étions confrontés :

1. Nous avions besoin d’un logiciel flexible qui s’adapterait à toutes les contraintes du show wonder.land. Ableton Live s’était imposé à nous pour American Psycho, nous avons donc réitéré ce choix.

2. Vingt acteurs devaient suivre le chef d’orchestre.

3. Le chef d’orchestre devait être au cœur du système avec un contrôle manuel et spontané de la vue de session dans Live.

4. Un orchestre de 9 musiciens devait pouvoir jouer seul ou en synchro avec les fichiers d’accompagnement (backing tracks) dont le tempo pouvait fluctuer.

5. Nous devions pouvoir déclencher une partie du jeu de lumières à partir de Live et en synchro avec la musique.

6. Un signal Timecode (LTC) devait être envoyé au département visuel pour synchroniser l’audio et la vidéo avec les backing tracks.

7. Nous allions devoir utiliser un certains nombres d’instruments et de sampleurs qui seraient soit créés à partir de la collection de synthétiseurs de Damon Albarn, soit issus de la librairie de Kontakt.

8. Nous ne devions pas utiliser la fonction warp d’Ableton afin de conserver la qualité audio optimum des fichiers d’accompagnement. Cela représentait un défi technique considérable étant donné que nous devions garder l’orchestre synchronisé avec des backings tracks dont la cadence fluctuait.

9. Il était donc évident que le spectacle serait entièrement lié au chef d’orchestre. Il jouait sur un clavier maitre pour déclencher les instruments samplés que nous lui avions préparés. Il déclenchait les scènes de live grâce à une pédale et dirigeait les acteurs et l’orchestre. Cette configuration rendit le spectacle très spontané et donna au chef d’orchestre la possibilité d’adapter l’aspect sonore et visuel du spectacle à la vitesse de jeu des acteurs. Il était au centre de tout ce système de diffusion avancé.

Production à Londres

À mon retour au National Theatre en Juin, ma première tâche consista à enregistrer les synthés vintages de Damon pour préparer des sampler instruments « jouables ». Il fallait d’abord accorder ces machines puis capturer leur son à différentes tonalités sur plusieurs octaves. Les sons ont ensuite été compilés dans un instrument de Kontakt. Le « Show File » (document de diffusion) final aura 3 Kontakts, tous chargés avec un grand nombre d’instruments. Ces « multi patches » seront alors automatiquement sélectionnés lorsque le chef d’orchestre déclenchera une nouvelle scène dans Live grâce à des clips ‘Fantômes’.

Nous avons ensuite commencé à aligner le timecode (LTC) avec le tempo de nos backing tracks (fichiers d’accompagnements), de manière à ce que l’équipe vidéo le reçoive avant le premier temps du morceau et qu’il tombe exactement sur la première minute sur ce premier temps. Le timecode a été généré au format audio sur ce site puis il a été aligné dans Logic le long des stems fournis par l’ingénieur de Damon.

Nous avons du ensuite communiquer avec le département de la régie pour organiser les stems dans Live afin de les adapter à la configuration de la console de mixage. En effet, il y avait jusqu’à 28 stems audio dans certains backing tracks. Elles étaient rassemblées dans 20 groupes et dispatchées sur la console à travers une carte son MADI.

L’un des challenges les plus importants fut le transfert de fichiers entre les différents documents des différents logiciels utilisés dans le processus. En effet, Damon travaille sur Protools. Les stems sont ensuite alignées au LTC dans Logic puis basculées dans Live. Comme nous avions décidé de ne pas controller la vitesse de jeu des fichiers avec la fonction de warping, alors que nous étions en vue de session de Live, nous ne pouvions lancer la lecture des morceaux qu’au début de ceux ci. Lors des répétitions, le directeur nous a demandé de commencer la lecture a un moment précis du morceau donc nous devions travailler tout d’abord dans la vue d’arrangement, puis ensuite basculer les stems dans la vue de session du document de diffusion final. Ces transferts devaient être réalisés avec le plus grand soin car certains fichiers pouvaient se perdre.

Un second ordinateur portable devait être aussi configuré pour le deuxième claviériste, qui lui se trouvait dans la fosse. Il s’agissait d’une version plus légère que l’ordinateur principal du chef d’orchestre. Il n’avait aucunes pistes d’accompagnement mais seulement les sampleurs Kontakt.

Un des morceaux d’accompagnement a été particulièrement difficile à traiter. Il avait des fluctuations de tempo et était divisé en trois sections/scènes distinctes. L’orchestre devait reprendre à la fin de chaque section afin de les lier avec la suivante. Cela donnait suffisamment de temps aux acteurs pour rentrer dans leur harnais. Étant donné que la fonction Warp n’était pas permise nous avons été obligés de contrôler le tempo d’Ableton dans la vue de session et de le forcer à suivre les fluctuations de tempo des backing tracks. De cette manière, nous avons pu garder Live et l’orchestre synchronisés. Il nous a fallu programmer un objet Max for Live pour réaliser cela.

Cet outil nous permettait d’écrire une automation de tempo à la décimale près dans Live en écran Session.

Aperçu du show « wonder.land ».

Répétitions à Manchester

15 jours avant la première représentation de Wonder.land, nous avons déménagé au « Théâtre Palace » de Manchester. Nous passions alors 14 heures par jour dans ce lieu mythique pour configurer le système et répéter le spectacle.

Nous avons tout d’abord basculé nos signaux vers la console. Celle-ci était contrôlée en live par un ingénieur pendant le spectacle. Il gérait alors 30 pistes en temps réel pour contrôler tous les micros de scène et il déclenchait les effets sonores ponctuels à la volée.

Nous avons ensuite vérifié que notre timecode était correctement aligné avec les projections vidéo et corrigé quelques erreurs. Le timecode (LTC) est un code qui peut contenir jusqu’à 30 impulsions par seconde donc une extrême précision de placement est nécessaire. Ce fichier audio est incorporé dans le Show File sur une piste et il se déclenche automatiquement lorsqu’une scène démarre.

Ensuite nous avons mis en place un système de vocodage live: Les différents microphones pouvaient être envoyés dans Ableton à tout moment pendant le spectacle et être automatiquement vocodés grâce à un synthétiseur joué par le chef d’orchestre.

Ensuite nous avons ajouté une piste de déclenchement pour les lumières. Ces messages MIDI sont simplement placés dans des clips et envoyés vers l’interface MIDI. Ce système permet une synchronisation parfaite entre les lights et la musique.

Enfin, nous avons créé un autre Objet Max for Live pour permettre au chef d’orchestre de wonder.land de ne voir que les informations importantes sur son écran. Cette fenêtre flottante affiche le nom de la scène en cours de lecture, le nom de la scène suivante, et la position de la pédale de volume de son clavier.

Finalement, nous avons transféré le document de diffusion (’Show file’) sur l’ordinateur de back up (B) qui tournait en synchro avec le principal (A). Nous avons assigné tous les contrôles hardware à l’identique sur ces deux machines afin que tous les mouvements soient communs aux deux ordinateurs. Le chef d’orchestre et l’ingénieur de regie ont tous deux un bouton rouge pour permuter entre les deux ordinateurs a tout moment du spectacle en cas de crash.

Voici quelques principes importants que j’ai retenus de cette expérience wonder.land :

- Toujours vérifier trois fois les manipulations que vous faites. C’est un environnement professionnel et les gens s’attendent à ce que tout fonctionne. La technologie doit être transparente pour les acteurs et ou les musiciens.

- Respecter la hiérarchie, se référer uniquement à ses supérieurs directs, car les autres informations délivrées par les autres départements peuvent vous être préjudiciables.

- Sur un travail long comme celui-ci, la fatigue peut rapidement être pénalisante, et il faut s’assurer de prendre suffisamment de repos sur toute la durée.

Écrit par Freddy Frogs (Ableton Certified Trainer) de l’école audio numérique Fastlane.